Open Virtual Exhibition プログラム詳細

発表番号は 部屋(A~C) + 番号 + (発表日) を表します。全日程 9月16日(水)16:00-18:00 9月17日(木)17:00-19:00 9月18日(金)17:00-19:00 タイトルのみ

ポスター会場は、Hubs VRの各部屋ですが、体験デモ ライブデモはDiscordの「OVE発表別」エリアのチャンネルが中心です(Discordの入り方)

OVEはYouTube Live(16日 17日 18日)で中継します。1分発表1分質疑です。

HCI・モデル・シミュレーション

デバイスの制作過程まとめ

ライブ動画の配信が仕様上不可能であったため動画を配置することにします。

ARコンテンツにおいて,ジェスチャやコントローラーによる操作は現実世界と異なる体験である.特に操作する仮想物体への触感がなく,操作の心地よさが現実世界とは乖離している.よって,本研究ではARコンテンツで現実世界の自然な操作感と触覚的な心地よさを付与できるインタフェースとして,スタンプに着目した.スタンプは自然な動作で正確な位置を指定でき,さらにスタンプを押す動作,触感,音は心地よさを伴う.そこで,このスタンプを利用したデバイスを作製し,ARゴーグルと連動させるシステムを構築してARコンテンツへの活用を提案する.

要素技術検証アプリ操作

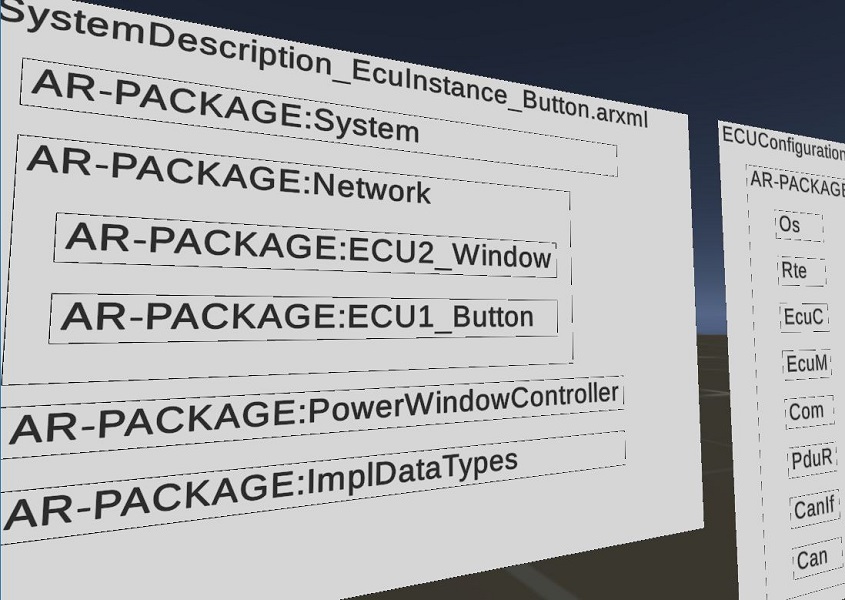

自動車業界で多くの企業が導入を進めている「AUTOSAR」。その定義ファイル(AUTOSAR仕様のXMLフォーマット)は参照が多く、近年の車載ソフトウェアの大規模化により複雑さを増している。 前年度の研究では、有向グラフを使用して参照の表現を簡略化し、全体像を俯瞰できる独自の表記法を使ったPC上で動く試作ツールを開発したが、定義ファイルの情報量が多い場合、グラフがディスプレイの枠内に収まらず「俯瞰しづらくなる」という課題が残った。 今年度は上記の対策として、ユーザーの周囲を広く使えるVR空間上に有向グラフを自動生成し、その有効性の検証(可読性)を試みる。 ※ユースケースとしてはVRを利用した企業内レビュー(マルチユーザー)を想定している

視覚(HMD)

現実空間に比べて仮想空間では動体視力が落ちる。単純には、HMD などのディスプレイでは、 フレーム期間中は表示内容が変わらないため、運動する物体をパースートすると生じるブラーのためと 考えられるが、被験者実験の結果はこの説明とは異なり、動体視力が視角速度とフレームレートの線形 結合の関数であることを示した。これは静止視力における指標サイズのような仮想空間における動体視 力の軸であると考えられる

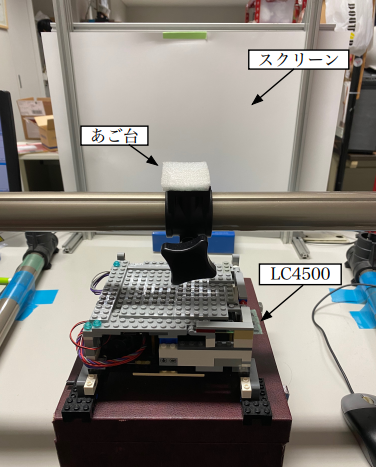

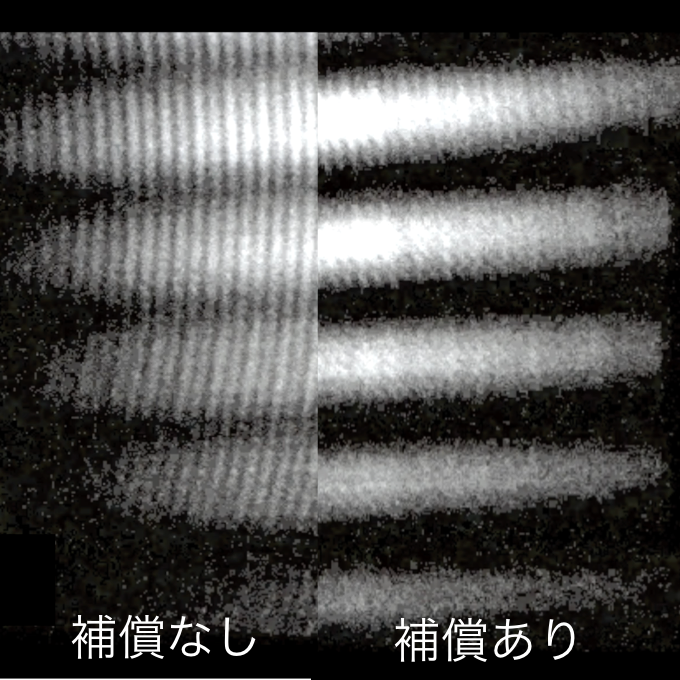

光学シースルーHMDを単純な光学系で作る場合,広視野を得るためにワイドコンバージョン鏡を使用すると収差のため十分な解像度が得られない.3次元像を結像することができる光線空間プロジェクタを収差補償に用いれば,解像度制約を解消できると考えるが理論的には未整備である.本研究では,観察像の解像度を光線追跡シミュレーションと実測値によって求め,光線空間プロジェクタによる収差補償の効果を評価した.

視覚(立体ディスプレイ)・ロコモーション

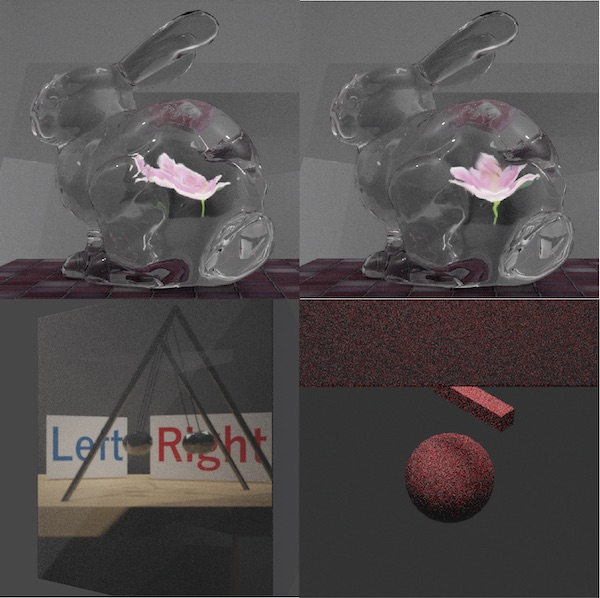

再帰透過光学素子の活用は,視域や迷光,光源サイズなどの検討のため,実際の光学系を組み立 てる必要があり,多くの労力を要する.そこで,レイトレーシング法によるシミュレーションを検討す る.再帰透過光学素子を用いた既存の光学系を再現し,その性質に対する追試をシミュレーション内で 行った.実験の結果,シミュレーションの応用可能な場面と限界が判明した.

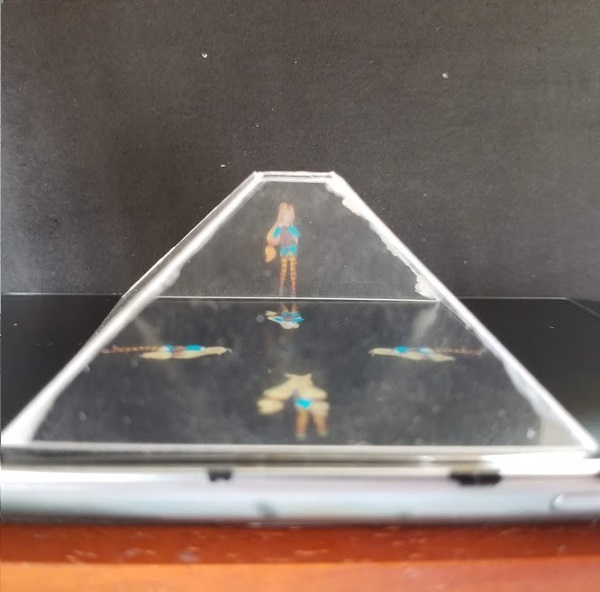

ペッパーズゴーストによって表示される空中像を回転させ、全方位から観測可能な立体像を生成することが目的である。ペッパーズゴーストの視域を制限するため、視野角制御フィルムと組み合わせて立体像の表示を目指している。試作にあたってUnityでシミュレーションを作成し確認を行っている。立体像表示に適した視野角制御フィルムの性能や、回転速度を調査している。

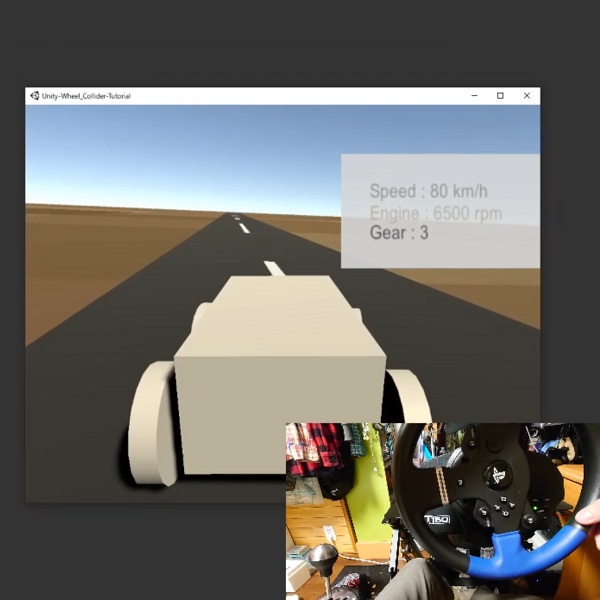

コンテンツ内のユーザ視点の加速度に応じて描画面を移動,拡大縮小させることで臨場感を高め,移動感覚を提示することができないかと考えた.これを検証するために,Unityを用いてシミュレーションを行った.自動車を題材として,自動車の加速度をリアルタイムで取得することで,様々な運転操作による加速度の変化に対応させ,描画面を移動,拡大縮小させることができた.

医療・健康・心理

視空間認知障害は脳卒中に合併する高次機能障害である. 代表的なものは左半側空間無視で,自身の左空間を認識できず,左側の障害物に衝突するなどの現象がみられる.臨床における障害度の判定は紙面上の検査で行われるが,3次元空間では、その障害特性は見出せない場合がある. そこで,本研究では3次元空間内での障害特性を把握するためにVRを用いた新たな評価ツールを開発した.このツールではHMDを用いて仮想空間内で物体の探索課題をおこない,正しく認識できない領域を判定する.また,課題遂行中の眼球の動きをトラッキングし,視線による探索動作も分析に使用することができるため,視空間認知障害の新たな特性を見出す可能性がある.

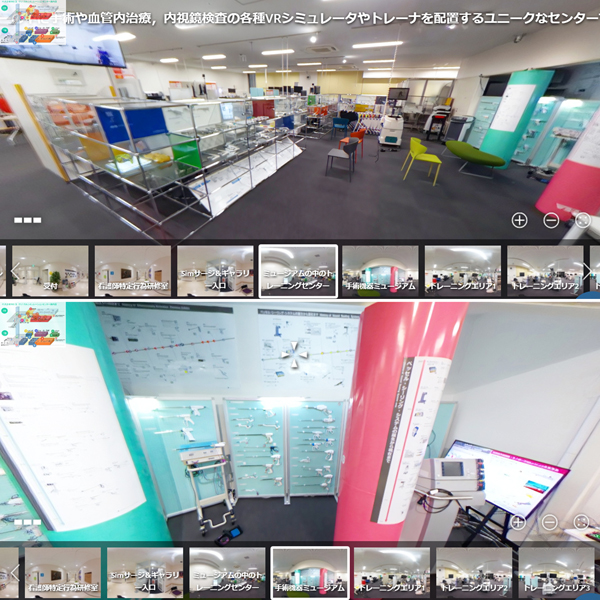

我々の施設は,シミュレーション医療教育や研究,診療支援のセンターである.中核であるSimサージ&ギャラリーは,1990年代から急激に発展した内視鏡手術機器を中心とした手術機器のミュージアムの中に,手術などのトレーニング機器を配置するというユニークな構造である.手術機器の作動原理,機能の特徴や注意点に関する情報をどのように伝達するかが課題である.現在は,実機やVR手術シミュレータの近傍で映像展示を併用しているが,個別の機器の情報提供を含め,より機器と直結した情報提示が必要と考えられる.今年,Covid-19感染のため,学外者が来訪してセミナーに参加することが困難となり,実際に来館されなくても見学できるバーチャル・ミュージアムを作成してみた.

VR応用(教育・産業)

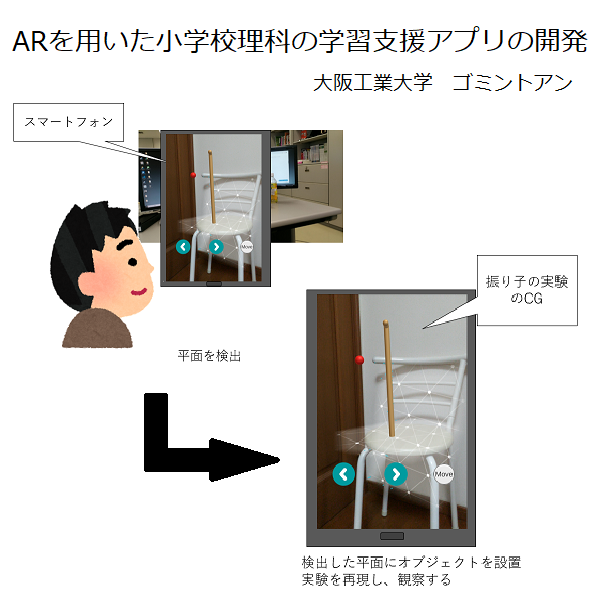

使用機材は、UnityとARCoreです。ARCoreとは、GoogleがAndroid向けに提供しているARプラットフォームです。スマホ内蔵のカメラやモーションセンサだけでARコンテンツを構築することができます。 内容は、平面を検出し、その平面上にあらかじめ設定した実験の道具を設置します。それを操作して、観察するというイメージです。現在作成したものは振り子の実験を再現しており、支点と球の距離や球の重さを変更すると揺れる周期がどう変わるかという実験です。現在は事前に決めた設定のものを置いて観察するというものになっておりますが、使用者が球の重さや支点との距離を設定できるようにする予定です。

電気刺激による筋収縮を利用し,投球動作時のリリースポイントを訓練するためのシステムを作成した.一般的に,電気刺激・機械刺激などの外部刺激による身体運動には,ユーザーの運動主体感が伴わないことが多い.しかし近年の研究では,ユーザーの意思よりも僅かに早く電気刺激で身体を動作させた場合に,運動主体感が生じることが報告されている.そこで運動主体感を活用した技能訓練システムの試作として,前腕筋への電気刺激を用いた投球時リリースポイント訓練システムを作成した.

身体・アバター・コミュニケーション

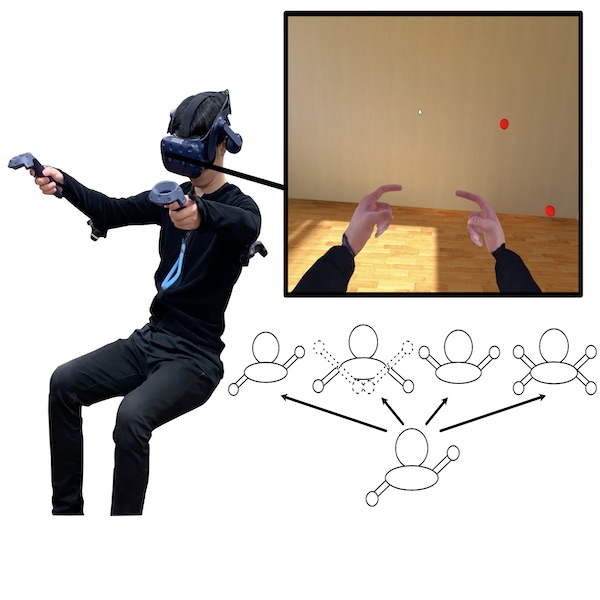

人は2本の腕を持っているが,VRやロボティクスを用いて制御方法や形態を変化させることが可能である.両腕を50%ずつの割合で制御する融合モード,片手で両腕を制御する複製モード,両腕で4本の腕を制御する超複製モードという3つを自在に変化させることのできるEditable armを開発した.精度を重視する作業や,速度・量を重視する作業といった様々な状況に応じて制御と形態を変化させることにより,通常よりも効率的・高速な作業が可能となることが期待される.また,片腕を動かせない方でも,健常者と同等の作業を可能にするだけでなく,より最適化された作業を行える可能性を持つ.

私は学部でVR空間のアバタに対する身体所有感生起についての研究を行っていました.私の研究の最終的な目標はVR空間のアバタへ完全に身体転移をしVR空間を自由に動けるようにすることです.今回はその目標への第一歩として身体所有感に関連した様々なアイデアを紹介し意見をいただきたいと考えています.具体的には腕に重心を変化させるようなデバイスを取り付けた時に腕が伸びたような錯覚を引き起こすのか,身体を動かさずにアバタを操作した際の身体所有感はどうなるのか,磁石の反発を利用した触覚デバイスを用いた時疑似的な凹凸の触感を再現できるかなどの案を考えています.

ハプティクス

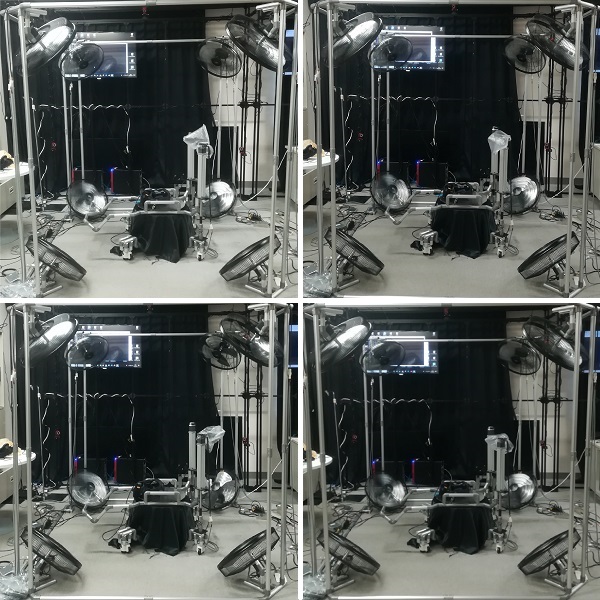

本研究ではリアルからバーチャルに干渉可能な複合現実型風力呈示システムを提案する。具体的には、リアル側のユーザがVIVEコントローラーで仰ぐと、仰ぐ速度と方向に応じた風が現実世界とバーチャル世界共に発生する。このシステムを利用することによって、例えばフライトコンテンツにおいて、フライト中のユーザの操作を邪魔したり、支援したりする等、観覧者も一緒になって同じVRコンテンツを楽しむことが期待できる。

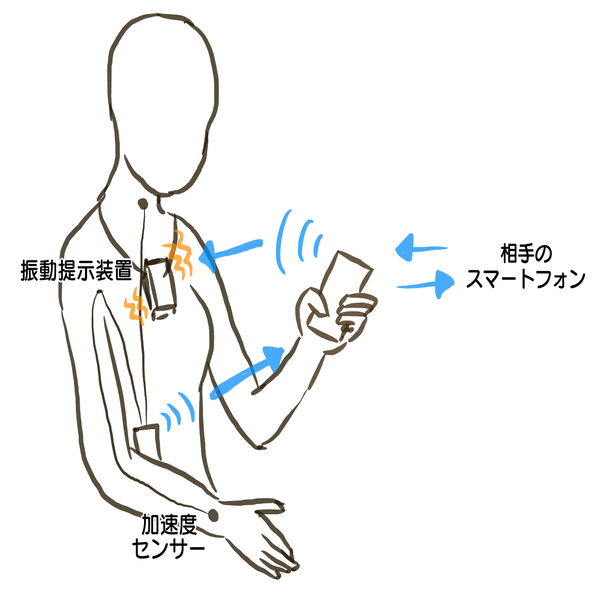

本研究では,日常生活の動作や話している雰囲気を,振動として常に相手に伝える相互常時触覚通信を提案する.この通信は,前腕の動きと喉の震えを加速度センサーで測定し,相手の首周りの振動提示装置に振動波形として伝える手法である.この手法を用いて長期間利用し,振動に慣れることで,振動から伝わることや日常生活に及ぼす影響を調べることを目的とする.本稿では,長期間利用できるようなシステムの提案およびシステム構成について述べる.

アート・エンタテイメント

桜美林大学の杉森研究室では、新たにVTuber「林美桜(はやしみお)」を制作し、公開を行った。スクールカラーのワインレッドと桜からイメージを広げ、若者から支持されることを目指してキャラクターデザインを行い、校名の「桜」「美」「林」にちなみ名付けた。中の人(声優)は、学内外に向けた公募によるオーディションを実施して、イラストのイメージに合わせて人選を行った。4月から企画を始めLive2D、FaceRig、Adobeソフト等を用いて制作し、8月に公開。その過程で2Dモデルが表現出来る動作や表情の限界、キャラクタープロデュースの難しさ、体制の維持などの課題が明らかになった。現在よりリアルな動きや表現力が期待できる3Dモデルの制作を進めている。

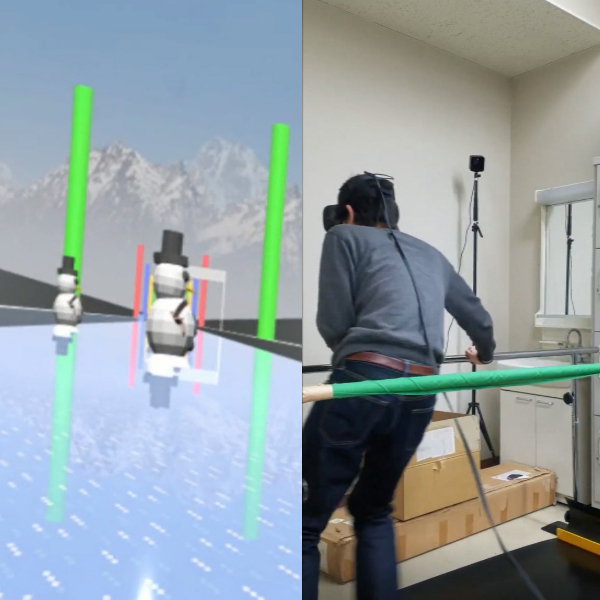

人は視覚や前庭感覚、体性感覚などの複数の情報を統合して運動感覚を知覚する。先行研究においても、映像にあった身体動作を提示することにより、より現実体験に近い感覚を得ることが示されている。これらの原理を応用し、左右移動の運動刺激とその移動量とシンクロした形で前進する視覚刺激を提示することで移動感を与える、トレーニング用スライドボードを用いて楽しめるVRスケートゲームを考案した。このゲームでは、現実空間にてスライドボード上で左右の動きを行うと仮想空間内で前進し、まるで実際にスケートをしているかのように楽しむことができる。

0-9studio ホームページ

これまで環境音の音声処理手法は多々あるが,その正確な制御に基づく音階構成,等は困難だった.例えば,既存音楽技術を鑑みれば,その音源は概して電子音源の類(録音再生,アナログ電子音,デジタル電子音,等)だったと思われる.しかし,本手法によると,人間行動でありうる環境を音源として,その振動に基づく音波を処理し,環境由来の生楽音を響かせることができる.その結果,例えば,環境の振る舞いを音楽構成の一部として予定し,文化性(culturality)等の音声成分を抽出してオシレーター(ノコギリ波発振子等)のように演奏する作曲,サウンドデザイン,生楽音のバーチャル演奏,等の展望が開ける.

テレプレゼンス・聴覚提示

テレプレゼンス分野の歴史は長く,遠隔地での体験を伝えるための研究開発が行われている.テレプレゼンスロボットの操作において,ジョイスティックやキーパッドを使用すると,体験中の歩行感覚を低下させてしまう可能性がある.本展示では体験者の腕振りを遠隔ロボットの入力操作とすることで,遠隔地を移動する際の臨場感を高めつつ,映像による視覚と足音のフィードバックを行う構成を提案する.遠隔ロボットとして,2台の360度カメラを取り付けたオムニホイール型ロボットを開発し,平面を3自由度で移動することができる.体験では,体験者が腕を振ることで遠隔ロボットを操縦でき,東京都立大学の様子を見ながら移動することができる.

アバターロボット反応の遅延を連続に知覚しないために,ユーザはロボットを連続的に操作する必要がなく,ロボットが行動するときに感覚フィードバックを受動的に知覚できる方法を提案した.ロボットはユーザの音声を認識でき,ユーザの指示に従って協調作業を行う.これによって,ユーザが感覚フィードバックの連続遅延の知覚や疲労感を低減し,経験の質やタスクの効率も向上させると考えた.デモ体験では,参加者は与えられたURLとRoom IDにアクセスし,いくつかのターゲットを探してもらうようにロボットを指示する.そして,ロボットが動くとき,歩行音と映像の感覚フィードバックを知覚する.