Wednesday, 14 September

9月14日(水)

口頭発表 9:30-10:50 テレプレゼンス

座長:近藤 亮太(慶應義塾大学)

- 3D1-1

-

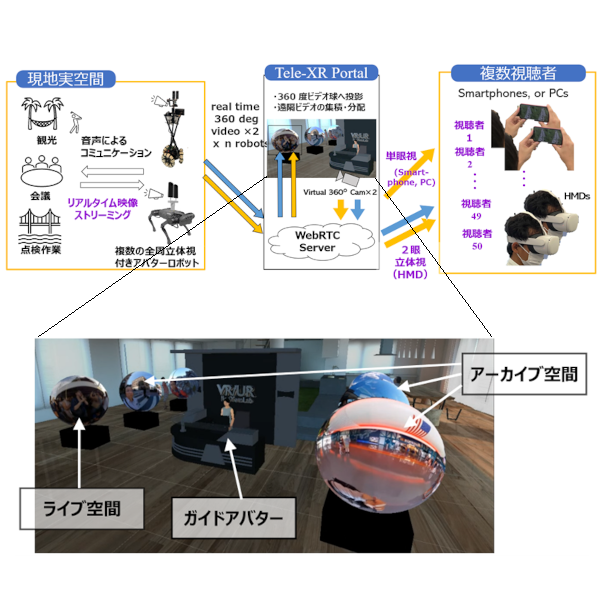

遠隔ライブ・記録映像の全方位マルチ視聴 XRメタバースシステムに関する研究

〇菊地 勇輔(東京都立大学)、小島 優希也(東京都立大学)、長井 超慧(東京都立大学)、YEM VIBOL(東京都立大学)、池井 寧(東京大学) - 社会活動のリモート参加は引き続き重要になると考えられる. 現状、その手段としてはWebカメラを用いた会議システムが利用されるが,会議システムの視野は狭画角のカメラ方位に限定され、任意視点、立体視の利用ができないため空間の正確な把握が難しい。 本研究では、全方位立体視カメラを利用することで遠隔の実空間映像を取得し、複数の参加者が遠隔の実空間とアーカイブ映像およびメタバース仮想空間を体験できるTele-XR Portalを提案する。

- 3D1-2

-

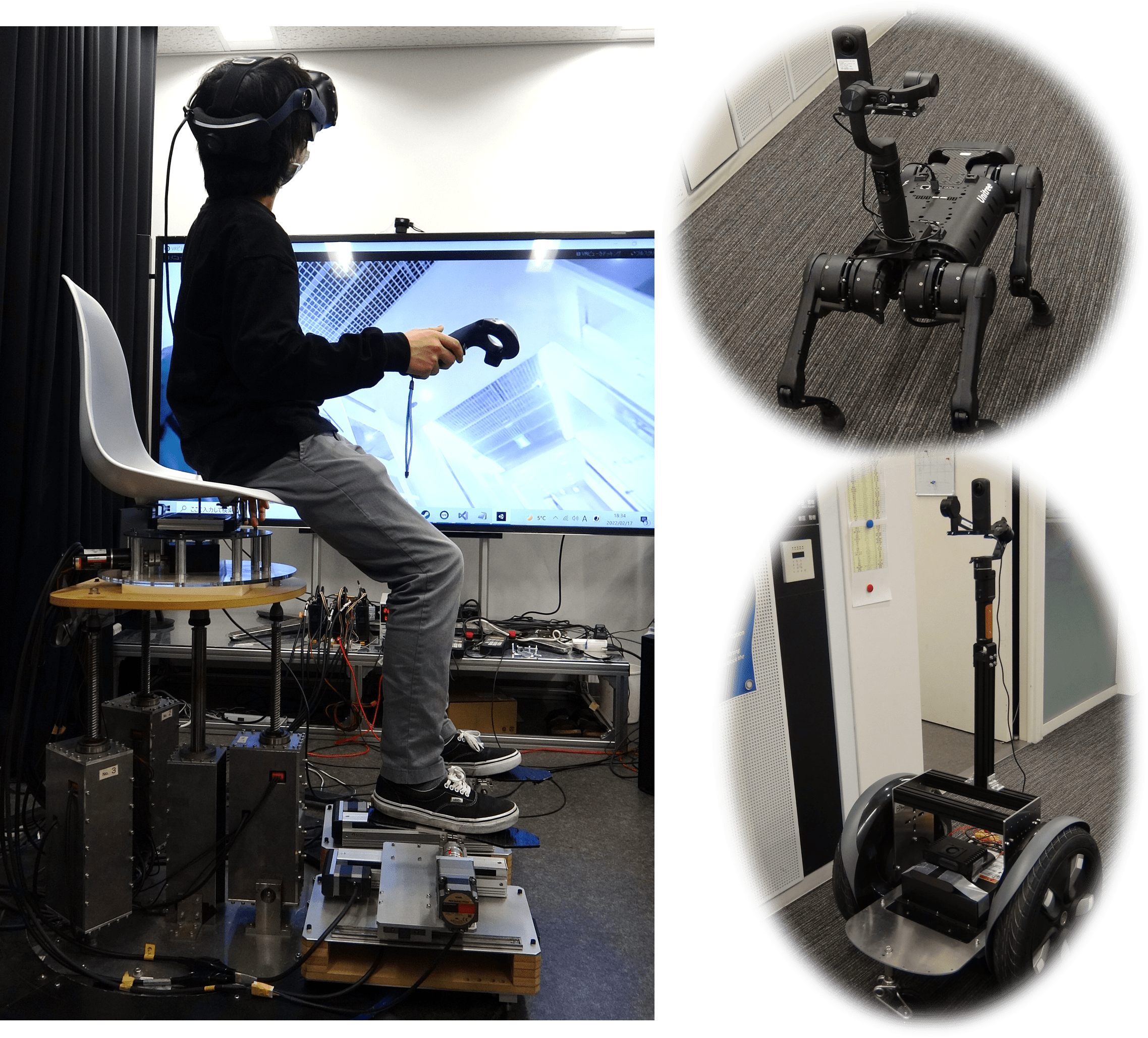

テレプレゼンスロボットと歩行感覚フィードバックを用いたリアルタイムマルチ空間の体験

〇小島 優希也(東京都立大学)、菊地 勇輔(東京都立大学)、YEM VIBOL(東京都立大学)、池井 寧(東京大学) - 本稿では,時間と空間の制約を超えることを目的として,遠隔地にある二輪型と四足型のテレプレゼンスロボットをリアルタイムでほぼ同時に操作することを可能としたシステムを構築した.操縦者は複数の遠隔空間を選択可能であり,歩行感覚フィードバックを与えることで,VR酔いを抑制するとともに没入感を向上させる.また,本システムではテレプレゼンスロボットの視点を50人の参加者まで共有することが可能である.

- 3D1-3

-

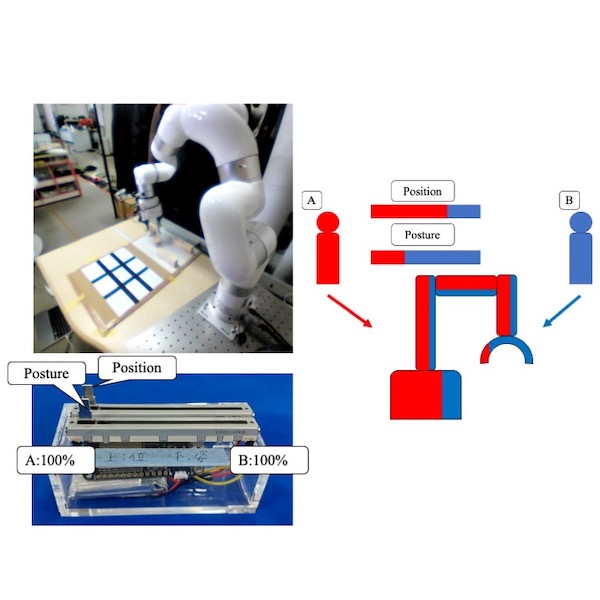

身体融合ロボットアバターにおける役割分担割合と主体感および操作感の関係調査

〇小倉 樹(名古屋工業大学)、岨野 太一(慶應義塾大学大学院理工学研究科)、大澤 博隆(慶應義塾大学理工学部管理工学科、筑波大学システム情報系知能機能工学域)、湯川 光(名古屋工業大学)、萩原 隆義(慶應義塾大学大学院メディアデザイン研究科)、南澤 孝太(慶應義塾大学大学院メディアデザイン研究科)、田中 由浩(名古屋工業大学) - 筆者らは、複数人が1 台のロボットアバターを操作する身体融合に関する研究を行なっている.従来では操作開始前に各操作者が受け持つ割合や制御対象を設定して融合していたが,これを動的に変化させることで,主体感や操作性の向上が期待できる.本研究では,2人で身体融合ロボットアバターを操作中に位置と姿勢の融合割合を任意に変化できるシステムを構築し,積み木作業を対象にして主体感や操作性との関係を調べた.

- 3D1-4

-

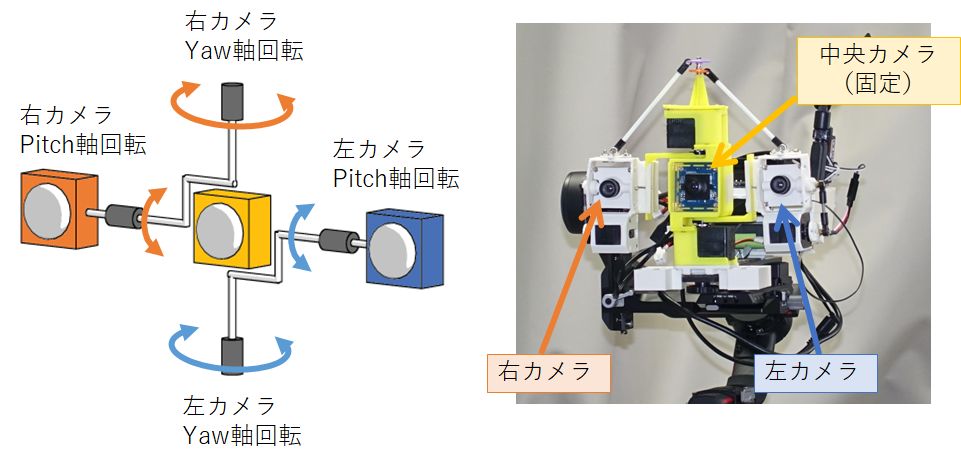

3眼アバターロボット:ユーザの視野を相互共有するテレプレゼンスシステム

〇井上 康之(豊橋技術科学大学)、北崎 充晃(豊橋技術科学大学) - 複数ユーザがひとつのアバターを操作する共有身体システムを使ったテレプレゼンスを実現するには、ユーザごとに異なる頭部方向に対応したアバターの視点映像をどのように取得して各ユーザの視野に提示するかが課題である。本研究では、左右カメラに加えて中央に「第3の目」を備えた3眼アバターロボットを開発し、各カメラの映像をユーザ間で共有する「2人3眼」式のテレプレゼンスシステムを提案する。