Wednesday, 16 September

2020/9/16(水)

一般発表 9:00-10:20 ユーザインタフェース

座長:小池 崇文(法政大学)

- 1C1-1

-

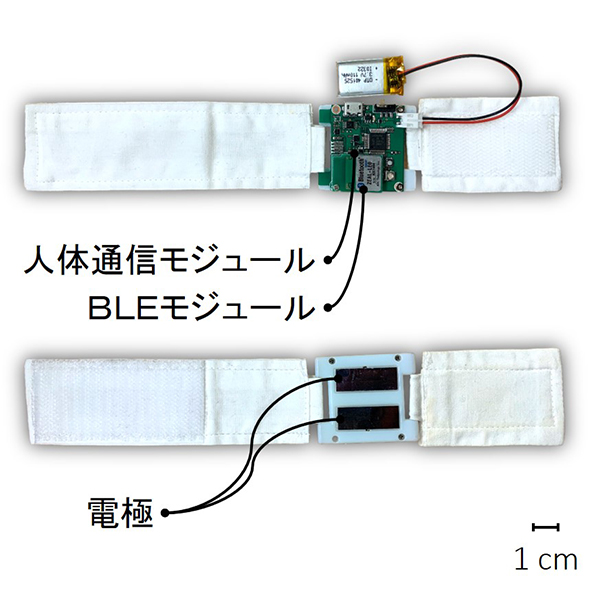

- 身体の物理的接触を拡張するウェアラブルデバイス(第9報):電流式人体通信のための電極最適化基礎検討

〇蜂須 拓(筑波大学)、鈴木 健嗣(筑波大学) - これまでに我々は複数名間の手指の物理接触を電流式人体通信を利用したブレスレット型デバイスより計量する研究に取り組んできた.本デバイスにおいて,手首に接触させる電極の形状と配置が通信品質に大きく影響を及ぼすことが知られている.一方でこれまでに定量的な評価がされていないため,電極の最適化が検討できていなかった.本稿では最適化のための基礎検討および信号雑音比を定量計測するシステムの開発について述べる.

- 1C1-2

-

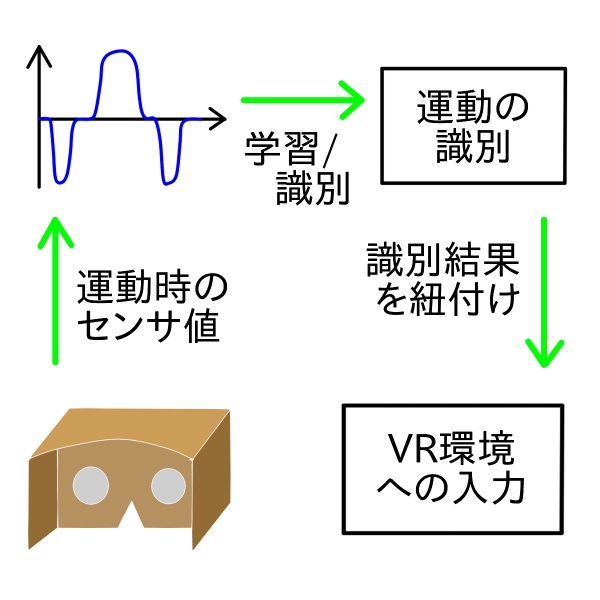

- 簡易型HMDに用いられるスマートフォンの内蔵センサを入力とした運動識別

〇松井 良太(慶應義塾大学)、加藤 花歩(慶應義塾大学)、杉浦 裕太(慶應義塾大学) - スマートフォンとVRゴーグルを用いたVR環境が普及している.本研究ではこの環境下で,スマートフォンの内蔵センサにより人間の運動を識別する手法を提案する.運動を行った際の各センサのデータをサポートベクタマシンによる学習に用いることで,ジャンプやターンなどの運動の識別を実現している.ユーザごとの識別精度検証を行った結果,16種類の運動に対して平均 92.03% の精度が得られた.

- 1C1-3

-

- 街探索のためのMovie Mapの自動構築と評価

〇杉本 直樹(東京大学)、相澤 清晴(東京大学) - 本研究では,全天球映像と地図を連携させたムービーマップの構築と評価について論じる.対象地域を交差点でのターンを含まず道に沿って撮影した全天球映像群と,それらの始点と終点の座標情報のみを入力とし,交差点同士を結ぶ映像群と交差点を曲がる映像群からなる映像データベースを自動的に構築するシステムを提案し,それを活用した探検型インターフェースの実装,ユーザースタディによる実用性の評価を行った.

- 1C1-4

-

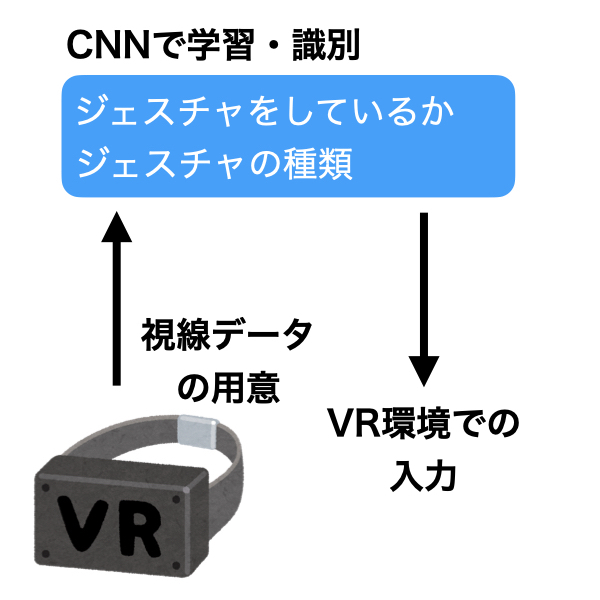

- VRゴーグルに内蔵されたアイトラッカを用いた視線ジェスチャの識別

〇張 翔(慶應義塾大学)、坂本 大介(北海道大学)、杉浦 裕太(慶應義塾大学) - 本研究ではVRゴーグルに内蔵されたアイトラッカを用いて視線ジェスチャを識別する手法について提案をする.ユーザがトリガなしでジェスチャを入力できるように,ユーザがジェスチャをしているか,どのジェスチャを行っているか,という2つの識別にそれぞれ機械学習で学習モデルを作成し,それらを組み合わせてジェスチャ識別するようにした.実際にVRコンテンツをプレイしながらジェスチャをして,識別精度検証を行った.

- 1C1-5

-

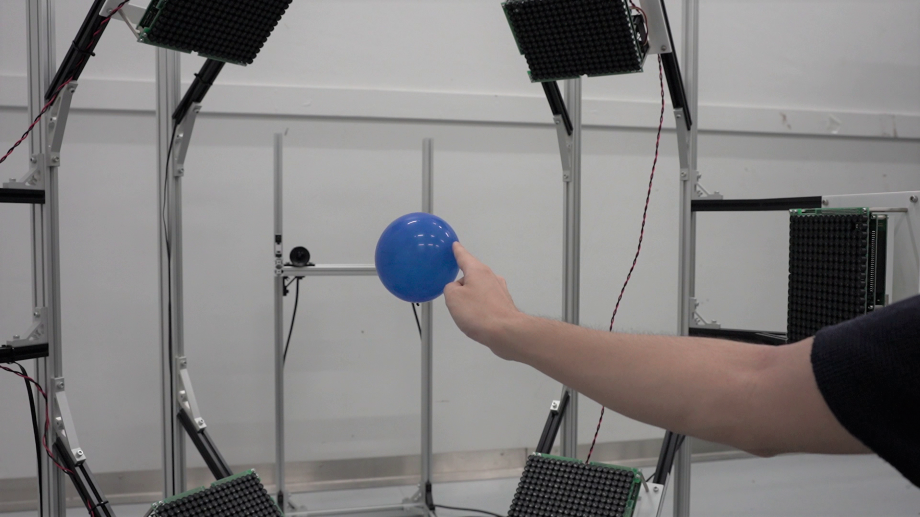

- 片手把持操作可能な浮遊型バルーンインターフェース

〇古本 拓朗(東京大学)、藤原 正浩(東京大学)、牧野 泰才(東京大学)、篠田 裕之(東京大学) - 本研究では,空中のオブジェクトを直感的に操作することを目的としたバルーンインターフェースを提案する.ユーザーは空中に浮かぶバルーンを片手で直接掴んで動かすことで,対応するオブジェクトの位置を操作することができる.小型のバルーンを,高速カメラと冗長に配置された空中超音波フェイズドアレイを用いてフィードバック制御することにより,接触時における安定浮遊と,従来よりも俊敏な動作を実現した.